YOLO est l’un des modèles de vision informatique AI les plus populaires qui détectent plusieurs objets et travaille hors de la boîte pour les objets sur lesquels il a été formé. Mais l’ajout d’un autre objet impliquerait généralement beaucoup de travail car vous auriez besoin de collecter un ensemble de données, d’annoter manuellement les objets que vous souhaitez détecter, de former le réseau, puis de le quantifier peut-être pour le déploiement de bord sur un accélérateur d’IA.

Cela est fondamentalement vrai pour tous les modèles de vision par ordinateur, et nous avons déjà vu l’impulsion de bord faciliter le processus d’annotation en utilisant GPT-4O et NVIDIA Tao pour former des modèles TinyML pour les microcontrôleurs. Cependant, les chercheurs de Jevois.org ont réussi à faire quelque chose de plus impressionnant avec la «détection d’objets ouverts» de Yolo-Jevois », basé sur le monde Yolo-World de Tencent Ai Lab, pour ajouter de nouveaux objets en yolo à l’exécution en tapant simplement des mots ou en sélectionnant des mots ou en sélectionnant partie de l’image. Il met également à jour les définitions de classe à la volée en une seconde, et Yolo-Jevois n’a pas besoin d’être re-paramétrisé ou requantisé.

Laurent Itti, fondateur de Jevois et professeur d’informatique, de psychologie et de neurosciences à l’Université de Californie du Sud, fournit plus d’informations et explique comment fonctionne Yolo-Jevois:

YOLO-WORLD (de Tencent AI Lab) a commencé à résoudre ce problème en vous permettant de définir toute classe que vous aimez pour la détection d’objets, par son nom. Pas besoin d’un ensemble de données de formation annoté, décrivez simplement en mots ce que vous voulez détecter. Vos définitions de classe personnalisées sont intégrées dans le réseau pour la faire s’exécuter rapidement, cela s’appelle Re-paramétrisation. Le problème est lorsque vous souhaitez quantifier votre réseau pour l’exécuter sur un appareil mobile ou un accélérateur matériel. Chaque fois que vous modifiez les définitions de classe, vous devez redémarrer, puis requantiser le réseau. La quantification nécessite un exemple de données de vos objets souhaités pour définir les paramètres de quantification et prend généralement plusieurs heures. Ainsi, lors de la quantification de Edge IA, nous perdons la commodité de Yolo-World: nous avons encore besoin d’un ensemble de données pour les nouvelles classes, nous devons toujours passer des heures à quantifier le réseau chaque fois que nous changeons les classes.

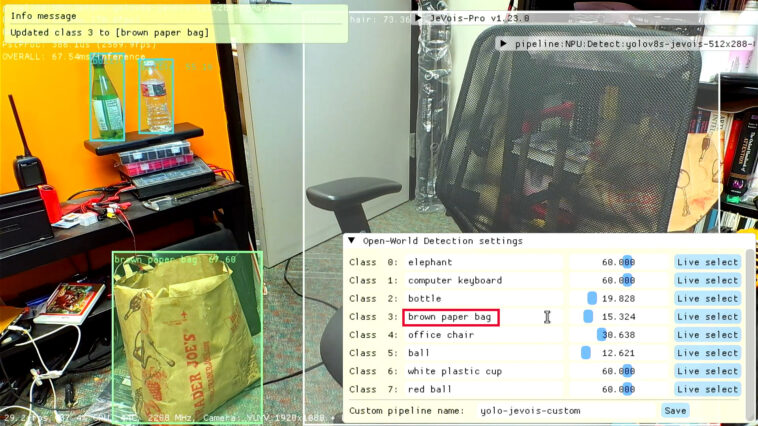

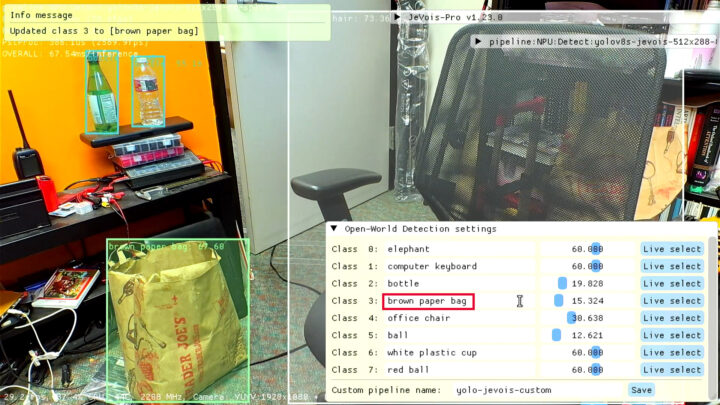

Les chercheurs de Jevois.org en ont maintenant abordé en modifiant les entrées et le flux de travail interne de Yolo-World, conduisant à un nouveau Yolo-Jevois. Yolo-Jevois prend des intégres de définition de classe de classe de manière partiellement transformés comme de nouvelles entrées. Le reste du réseau est ensuite quantifié une fois pour toutes. Au moment de l’exécution, il faut moins d’une seconde pour mettre à jour les incorporations de classe, et Yolo-Jevois n’a pas besoin d’être re-paramétrisé ou requantisé. Le résultat final est un réseau de détection d’objets quantifié et accéléré pour Edge AI, où les définitions de classe peuvent facilement être mises à jour au moment de l’exécution. En tant que bonus supplémentaire, les classes peuvent également être définies au moment de l’exécution par image: dessinez une boîte de délimitation sur un objet que vous aimez, et en moins d’une seconde, vous avez maintenant un détecteur pour cet objet.

Le meilleur pourrait être de consulter la vidéo ci-dessous à l’aide de la caméra Jevois Pro et du NPU intégré le SoC A311D AMLOGIC.

https://www.youtube.com/watch?v=4TXEAV2QWAA

La «détection d’objets à vocabulaire ouvert sur Jevois-Pro» est implémentée dans Jevois 1.23.0 qui n’a pas encore été publiée, mais vous trouverez le code source pertinent sur GitHub. Vous pouvez également consulter Jevois 1.23.0 Changelog sur le site Web de la documentation.

Retrouvez l’histoire de Raspberry Pi dans cette vidéo :