Nous avons précédemment testé la plate-forme d’apprentissage automatique Edge Impulse montrant comment former et déployer relativement facilement un modèle avec les données IMU de la carte de détection XIAO BLE. Depuis lors, la société a annoncé la prise en charge de la boîte à outils NVIDIA TAO dans Edge Impulse, et a maintenant ajouté le dernier LLM GPT-4o à la plate-forme ML pour aider les utilisateurs à former rapidement des modèles TinyML pouvant fonctionner sur des cartes avec des microcontrôleurs.

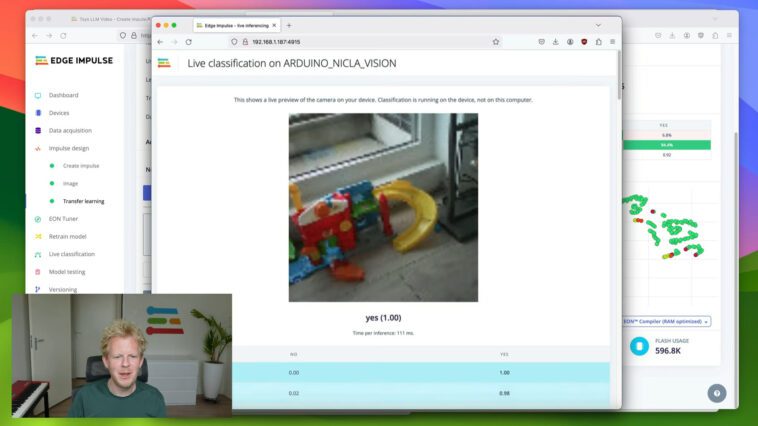

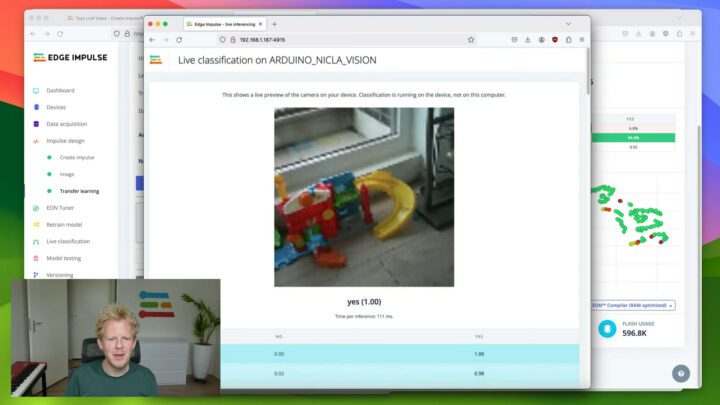

Ce qui est intéressant, c’est la manière dont les outils d’IA de diverses sociétés, à savoir NVIDIA (TAO Toolkit) et OpenAI (GPT-4o LLM), sont exploités dans Edge Impulse pour créer rapidement un modèle ML bas de gamme en filmant simplement une vidéo. Jan Jongboom, CTO et co-fondateur d’Edge Impulse, a démontré la solution en filmant une vidéo des jouets de ses enfants et en la chargeant dans Edge Impulse pour créer un message « Y a-t-il un jouet ? » modèle qui fonctionne sur l’Arduino Nicla Vision à environ 10 FPS.

Une autre façon de voir les choses (d’où le titre de la vidéo intégrée ci-dessous) est qu’ils ont réduit le GPT-4o LLM avec plus de 175 milliards de paramètres à un modèle spécialisé beaucoup plus petit avec seulement 800 000 paramètres adaptés pour fonctionner sur du matériel MCU.

Il y a cinq étapes de base pour y parvenir :

- Collecte de données : filmer une vidéo

- Traitement des données : téléchargement de la vidéo sur Edge Impulse pour la diviser par images avec des données non étiquetées.

- Étiquetage avec GPT-4o : à l’aide du nouveau bloc de transformation « Étiqueter les données d’image à l’aide de GPT-4o » dans Edge Impulse, les utilisateurs peuvent demander à GPT-4o d’étiqueter automatiquement les images, en supprimant toutes les images floues ou incertaines pour fournir un ensemble de données propre. La question était « y a-t-il un jouet ? » et la réponse ne pouvait être que « oui » ou « non ».

- Formation du modèle : une fois les images étiquetées (il y a environ 500 éléments étiquetés dans la démo), NVIDIA TAO est utilisé pour entraîner un petit modèle (MobileNet) avec ces images. Le modèle de la démo comportait finalement environ 800 000 paramètres.

- Déploiement : Le modèle peut désormais être déployé sur le matériel depuis l’interface web. Dans ce cas, un Arduino Nicla Vision pourrait détecter avec précision les jouets sur l’appareil, en temps réel (10 FPS) sans nécessiter de services cloud. Ce modèle a également été testé dans un navigateur Web à 50 FPS et sur un iPhone.

Vous pouvez regarder la vidéo ci-dessous dans laquelle Jan passe en test les principales étapes en 14 minutes environ.

Bien que certaines fonctionnalités d’Edge Impulse soient gratuites, le bloc d’étiquetage GPT-4o et les modèles d’apprentissage par transfert TAO ne sont disponibles que pour les entreprises clientes d’Edge Impulse. Si vous disposez d’une adresse e-mail d’entreprise, un essai gratuit de 2 semaines est disponible. Plus de détails peuvent être trouvés dans l’annonce.

Retrouvez l’histoire de Raspberry Pi dans cette vidéo :