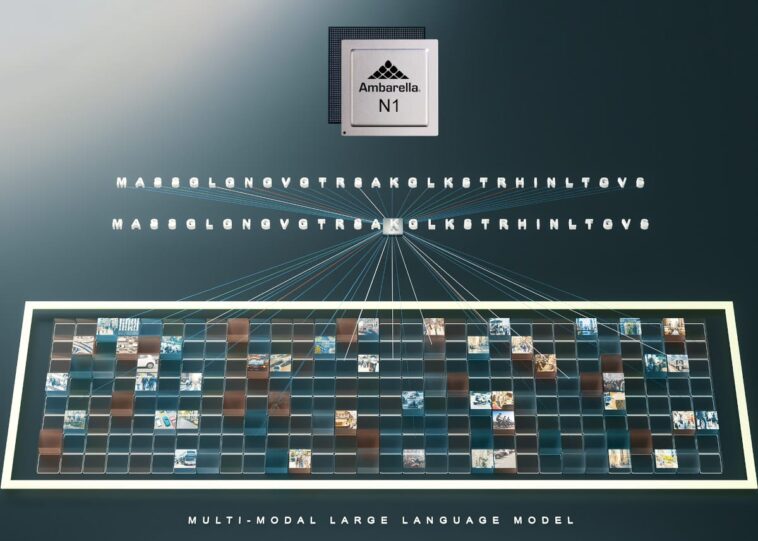

Ambarella a travaillé sur l’ajout de la prise en charge de l’IA générative et des grands modèles de langage multimodaux (LLM) à ses processeurs AI Edge, y compris la nouvelle série de SoC N1 50 W avec des performances de niveau serveur et le CV72S 5 W pour les applications de milieu de gamme à une fraction de la puissance par inférence des principales solutions GPU.

L’année dernière, l’IA générative était principalement proposée sous forme de solution cloud, mais nous avons également vu LLM fonctionner sur des ordinateurs monocarte grâce à des projets open source tels que Llama2 et Whispter, et des analystes tels qu’Alexander Harrowell, analyste principal chez Omdia s’attendent à ce que que « pratiquement toutes les applications de pointe seront améliorées par l’IA générative au cours des 18 prochains mois ». Les solutions Generative AI et LLM fonctionnant sur les processeurs Ambarella AI Edge seront utilisées pour l’analyse vidéo, la robotique et diverses applications industrielles.

Par rapport aux GPU et autres accélérateurs d’IA, Ambarella propose des solutions AI Edge SoC jusqu’à 3 fois plus économes en énergie par jeton généré, tout en permettant aux charges de travail d’IA génératives de s’exécuter sur l’appareil pour une latence plus faible. Ambarella affirme que le SoC N1 peut gérer simultanément les charges de travail de traitement du langage naturel, de traitement vidéo et de vision de l’IA à très faible consommation, tandis que les accélérateurs d’IA autonomes nécessitent un processeur hôte séparé et peuvent ne pas être aussi efficaces.

Les SoC Ambarella AI sont pris en charge par la nouvelle plate-forme de développement Cooper de la société, qui comprend un LLM populaire pré-porté et optimisé qui sera disponible en téléchargement à partir du Cooper Model Garden. Certains des modes pré-portés incluent Llama-2 et le grand assistant linguistique et vidéo. (LLava) fonctionnant sur N1 pour l’analyse de vision multimodale de jusqu’à 32 sources de caméras. Si je comprends bien, cela devrait permettre à l’utilisateur de saisir une recherche textuelle pour des éléments spécifiques dans le streaming vidéo, tels que « voiture rouge ». D’autres applications incluent le contrôle de robots avec des commandes en langage naturel, la génération de code, la génération d’images, etc.

Ambarella explique en outre que la série N1 de SoC est basée sur l’architecture CV3-HD, initialement développée pour les applications de conduite autonome, qui a été réutilisée pour exécuter des LLM multimodèles avec jusqu’à 34 milliards de paramètres à faible consommation. Par exemple, le SoC N1 exécuterait le Llama2-13B avec jusqu’à 25 jetons de sortie par seconde en mode streaming unique avec une puissance inférieure à 50 W.

Je n’ai trouvé aucune page de produit pour le SoC N1 ou la plateforme de développement Cooper au moment de la rédaction, donc la seule information dont nous disposons provient du communiqué de presse, et les personnes qui assisteront au CES 2024 pourront voir un LLM multimodal. démo fonctionnant sur une plate-forme basée sur N1 sur le stand Ambarella.

Merci à TLS pour le conseil.

Retrouvez l’histoire de Raspberry Pi dans cette vidéo :