Tout en recherchant des produits nouveaux et intéressants, j’ai trouvé la série DLAP Supreme d’Adlink, une série d’appareils AI Edge construits autour de la plate-forme Nvidia Jetson Agx Orin. Mais ce n’était pas la partie intéressante, ce qui a attiré mon attention, c’est qu’il a un soutien à quelque chose appelé la technologie Aidaptiv + qui nous rendait curieux. À la recherche, nous avons constaté que la solution AIDAPTIV + AI est une solution hybride (logiciel et matériel) qui utilise le stockage Flash NAND à faible coût facilement disponible pour améliorer les capacités des GPU pour rationaliser et mettre à l’échelle la formation de modèle à grande langue (LLM) pour les petits et moyens – entreprises de taille. Cette conception permet aux organisations de former leurs modèles de données sur le matériel standard et standard, surmontant les limitations avec des modèles plus complexes comme LLAMA-2 7B.

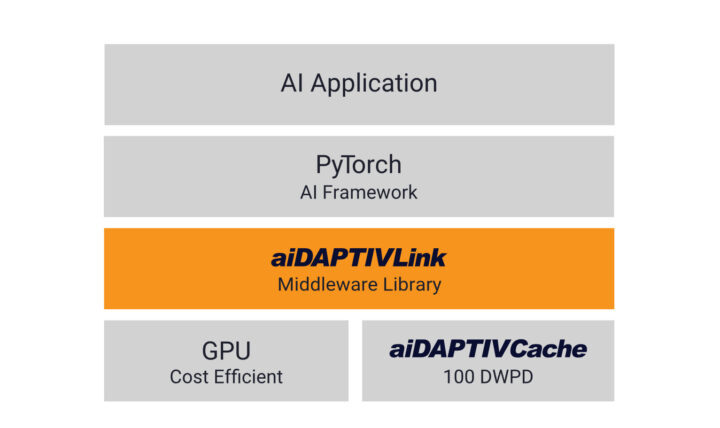

La solution prend en charge jusqu’à 70B paramètres du modèle avec une faible latence et un stockage à haute endurance (100 DWPD) en utilisant le NAND SLC. Il est conçu pour s’intégrer facilement aux applications d’IA existantes sans nécessiter de modifications matérielles, ce qui la rend accessible aux entreprises à la recherche de solutions de formation LLM rentables et puissantes.

Phison mentionne qu’ils ont utilisé une technique similaire à «l’échange» dans les systèmes d’exploitation. Lorsque la RAM d’un ordinateur est pleine, elle déplace des données moins fréquemment utilisées au disque dur pour libérer l’espace pour les processus actifs. De même, AIDAPTIV + exploite la grande capacité et grande capacité des SSD (SSDS AI100E M.2 de Phison) à étendre les capacités de mémoire des GPU. Ces SSD spécialement conçus ou «aidaptivcache» sont optimisés pour les exigences élevées du traitement de l’IA.

D’un autre côté, le middleware AIDAPTIV + gère le flux de données entre la mémoire GPU et les SSD. Il analyse les besoins du modèle d’IA, identifie les segments de données moins actifs et les transfère aux SSD, créant efficacement un vaste pool de mémoire virtuel pour le GPU. Cette technique permet la formation de modèles beaucoup plus grands que ce qui ne serait possible avec les GPU à bord.

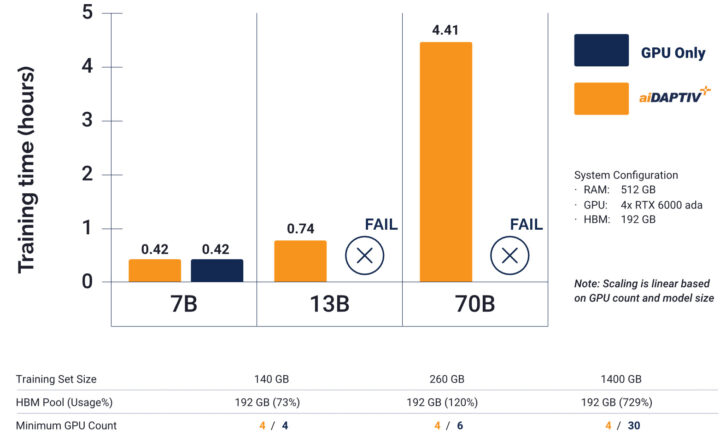

Le graphique montre le temps de formation pour les modèles de grandes langues de différentes tailles – 7b, 13b et 70b. Il compare les approches traditionnelles avec le système AIDAPTIV +. Le graphique indique que la formation d’un modèle 70B utilisant 4x RTX6000 ADA échouerait uniquement en utilisant les GPU, tandis que la solution AidAtViv + a réussi à former le modèle en 4,41 heures. Cette amélioration est due au middleware de Phison, qui optimise la mémoire GPU en tranchant le modèle, en maintenant des tranches en attente dans AidaptivCache et en échangeant des tranches efficacement entre le cache et le GPU.

Comme mentionné au début, la nouvelle série Supreme d’Adlink a lancé Adlink utilise la technologie AIDAPTIV + de Phison pour résoudre la mémoire et les limitations de performances dans les périphériques Edge pour une IA générative. La série DLAP Supreme atteint 8 fois des vitesses d’inférence plus rapides et des longueurs de jetons de 4x plus longues, et prend en charge une formation de modèle de langue grande, même sur des appareils avec des configurations de mémoire limitée comme Nvidia Jetson Agx Orin 32 Go en utilisant le modèle Gemma 27b. Cela permet aux périphériques de bord de gérer les tâches qui nécessitent généralement des GPU haut de gamme comme le H100 ou A100. Plusieurs sociétés comme Adlink, Advantech, Asrock, Asus et Gigabyte ont déjà incorporé la technologie Aidaptiv + de Phison dans leurs solutions.

Retrouvez l’histoire de Raspberry Pi dans cette vidéo :

-

GLOTRENDS PA52L Dual Adaptador M.2 NVMe a PCIe 5.0 X8 Sin bifurcación PCIe, configuración de Raid M.2 NVMe Suave OS Herramienta(se requiere placa Base Con bifurcación PCIe)

-

NFHK Oculink Kit M-Key vers NVME U.2 et adaptateur NGFF vers SATA pour carte mère