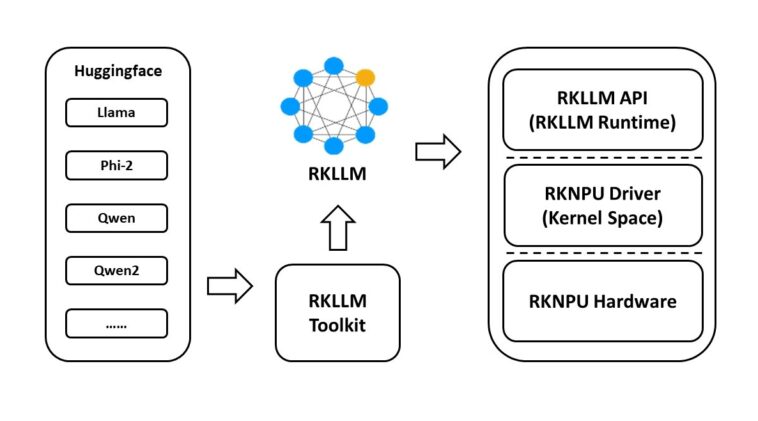

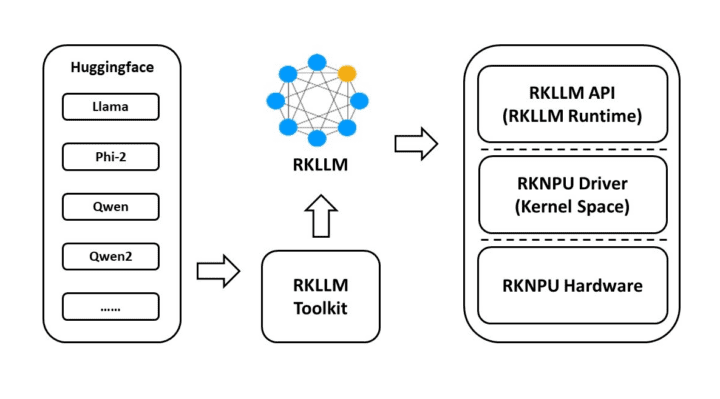

La boîte à outils Rockchip RKLLM (également connue sous le nom de rknn-llm) est une pile logicielle utilisée pour déployer des modèles d’IA génératifs sur Rockchip RK3588, RK3588S ou RK3576 SoC à l’aide du NPU intégré avec 6 TOPS de performances d’IA.

Nous avons déjà testé les LLM sur le SBC Rockchip RK3588 à l’aide du GPU Mali G610 et nous nous attendions à ce que le support NPU soit bientôt disponible. Un article publié sur X par Orange Pi nous a informés que la pile logicielle RKLLM avait été publiée et fonctionnait sur la famille d’ordinateurs monocarte Orange Pi 5 et le système sur module Orange Pi CM5.

Le manuel d’utilisation de l’Orange Pi 5 Pro fournit des instructions à la page 433 du document de 616 pages, mais Radxa a des instructions similaires sur son wiki expliquant comment utiliser RKLLM et déployer LLM sur les cartes Rockchip RK3588(S).

La version stable du RKNN-LLM est sortie en mai 2024 et prend actuellement en charge les modèles suivants :

- TinyLLAMA 1.1B

- Qwen 1.8B

- Qwen2 0,5B

- Phi-2 2.7B

- Phi-3 3.8B

- ChatGLM3 6B

- Gemma 2B

- Stagiaire LM2 1.8B

- MiniCPM 2B

Vous remarquerez que tous les modèles ont entre 0,5 et 3,8 milliards de paramètres, à l’exception du ChatGLM3 avec 6 milliards de paramètres. À titre de comparaison, nous avons précédemment testé Llama3 avec 8 milliards de paramètres sur le boîtier Radxa Fogwise Airbox AI avec un accélérateur AI 32 TOPS plus puissant.

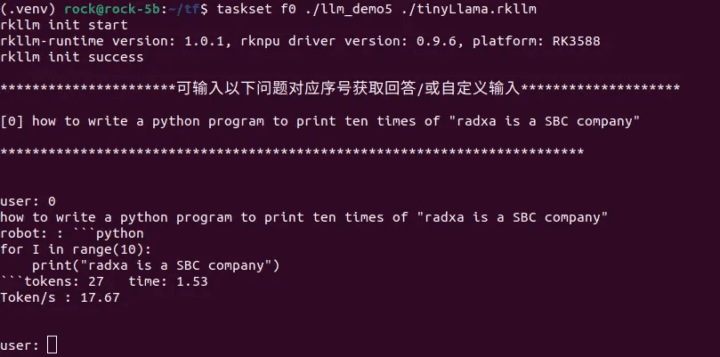

La capture d’écran ci-dessus montre le TinyLLMA 1.1B fonctionnant sur le Radxa ROCK 5C à 17,67 token/s. C’est rapide mais évidemment, c’est seulement possible parce qu’il s’agit d’un modèle plus petit. Il prend également en charge Gradio pour accéder au chatbot via une interface Web. Comme nous l’avons vu dans la test Radxa Fogwise Airbox, les performances diminuent à mesure que nous augmentons les paramètres ou la longueur de la réponse.

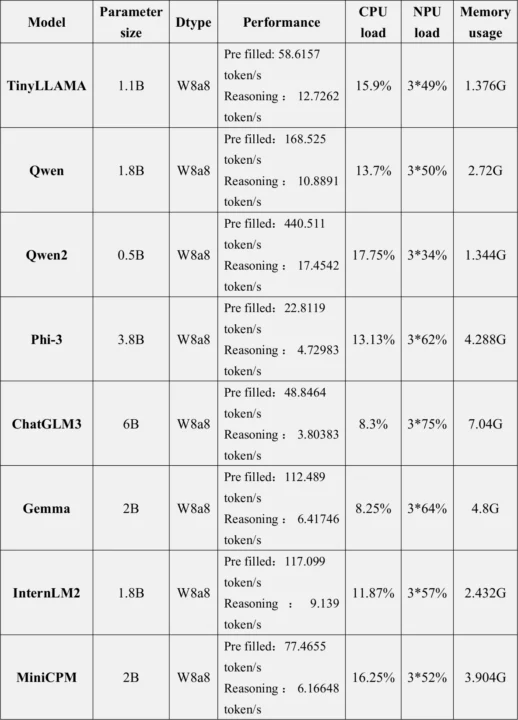

Radxa a testé différents modèles et a signalé les performances suivantes sur le matériel Rockchip RK3588(S) :

- TinyLlama 1,1 milliard – 15,03 jetons/s

- Qwen 1,8B – 14,18 jetons/s

- Phi3 3,8B – 6,46 jetons/s

- ChatGLM3 – 3,67 jetons/s

Lorsque nous avons testé Llama 2 7B sur le GPU du Mixtile Blade 3 SBC, nous avons obtenu 2,8 token/s (décodage) et 4,8 token/s (pré-remplissage). Il n’est donc pas certain que le NPU offre un avantage notable en termes de performances, mais il peut consommer moins d’énergie que le GPU et libérer le GPU pour d’autres tâches. Le manuel d’utilisation de l’Orange Pi 5 Pro fournit des chiffres supplémentaires pour les performances, les charges CPU et NPU et l’utilisation de la mémoire.

Même si les performances de « raisonnement » (décodage) ne sont pas tellement meilleures que sur le GPU, il semble que le pré-remplissage soit nettement plus rapide. Notez que tout cela a été fait sur le pilote NPU à source fermée, et des travaux sont en cours pour un pilote NPU open source pour le SoC RK3588/RK3576 pour lequel le pilote du noyau a été soumis à mainline le mois dernier.

Retrouvez l’histoire de Raspberry Pi dans cette vidéo :

-

YY3568 Rockchip RK3568 Kit de développement open source pour Android 11.0, Debian 10.0 et OpenHarmony OS, carte mère IA 64 bits (Advanced Kit with MIPI Camera 4GB RAM)