Le Fogwise Airbox Q900 AI Box représente une avancée significative dans le domaine des micro-serveurs, comme le rapporte cnx-software. Equipé d’un SoC Qualcomm IQ-9075, il offre jusqu’à 200 TOPS en performances IA, une mémoire RAM de 36 Go et un espace de stockage UFS de 128 Go, en faisant un concurrent sérieux sur le marché.

200 TOPS et Qualcomm IQ-9075 : une alternative séduisante au Nvidia Jetson Orin NX

Le nouveau micro-serveur AI de RADXA se positionne en compétition directe avec le Nvidia Jetson Orin NX de 16 Go. RADXA met en avant que son système est non seulement moins coûteux, avec un prix de 600 $ pour l’ensemble, mais qu’il offre également des performances comparables tout en améliorant l’efficacité. Avec ses cœurs Cortex-R52 dédiés aux tâches en temps réel, son réseau intégré à 2,5 GBE, ainsi que des GPU, NPU et DSP distincts, le Q900 se démarque nettement.

En termes de puissance graphique, le GPU Adreno 663 délivre des performances incroyables, atteignant jusqu’à 1,2 Tflops en FP32. Il supporte également les nouvelles normes telles que Vulkan 1.2 et OpenGL ES 3.2. Ce micro-serveur prend en charge des vidéos de qualité supérieure, permettant le décodage de formats variés, allant de l’AV1 à l’H.265, avec des capacités impressionnantes d’encodage et décodage simultané.

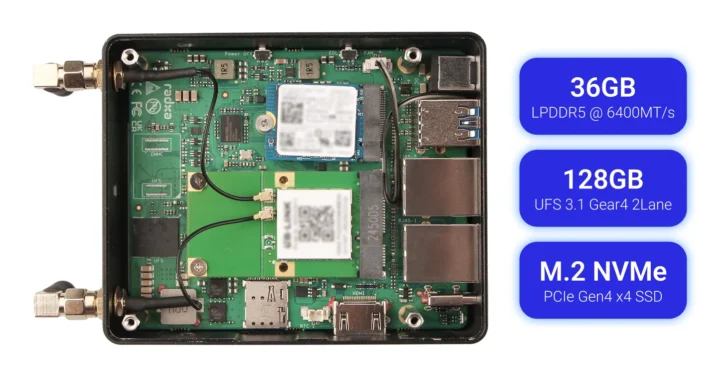

36 Go LPDDR5 à 6400 MT/s : un stockage supérieur par rapport au Nvidia Orin NX

Avec 36 Go de LPDDR5 fonctionnant à 6400 MT/s, le Fogwise Airbox Q900 propose une mémoire largement supérieure à celle de son concurrent, qui n’en dispose que de 16 Go. Toutefois, le module NVidia Orin NX se distingue par sa bande passante mémoire plus élevée, atteignant 100 Go/s contre 78 Go/s pour le Q900. Le Q900 comprend par ailleurs un stockage interne de 128 Go UFS 3.1, qui est un atout pour le système d’exploitation, alors que l’Orin NX nécessite un SSD externe.

En termes de performances d’IA, le Q900 brille avec ses 200 TOPS, surpassant les 157 TOPS du Orin NX lorsque ce dernier est en mode super performant. Ce micro-serveur fait le choix d’un GPU indépendant, ce qui permet d’éviter les points de congestion des performances. En plus, son architecture intègre un DSP audio dédié, permettant ainsi d’effectuer des charges de travail parallèles de manière plus fluide.

En ce qui concerne la connectivité, le Q900 prend en charge un réseau de deux ports 2,5 GBE avec TSN, tandis que le module Nvidia nécessite un matériel supplémentaire pour bénéficier de fonctionnalités similaires.

Il est à noter que la consommation d’énergie est également un facteur décisif. Le Fogwise Airbox Q900 fonctionne avec une consommation de 20 W en mode normal, tandis que le module Nvidia Orin NX utilise 45 W pour atteindre sa performance maximale de 157 TOPS.

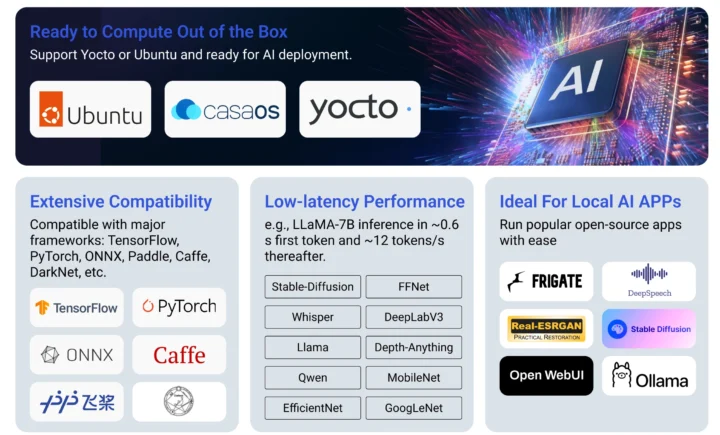

Pour les développeurs, RADXA assure la compatibilité avec Ubuntu et Yocto Linux, ainsi que différents frameworks d’IA tels que TensorFlow et Pytorch. Cela permet une exécution locale d’applications comme GPT et des modèles comme LLAMA-7B, récoltant ainsi des performances intéressantes avec des temps d’inférence remarquables.

En conclusion, le micro-serveur Fogwise Airbox Q900 AI est disponible dès à présent pour 599 $ sur ARACE, offrant une solution avantageuse face à la concurrence de Nvidia. Plus d’informations peuvent être consultées sur la page produit pour découvrir l’ample éventail de fonctionnalités de ce dispositif.