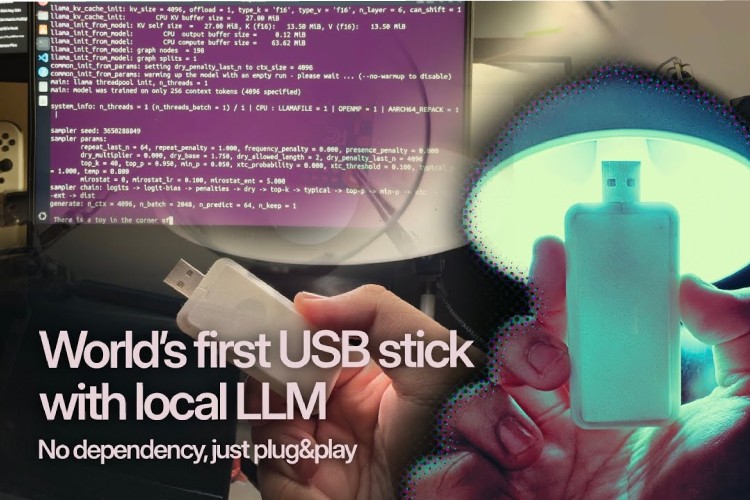

Les modèles de grands langues (LLM) comme GPT, Bert, Llama et Mistral sont largement utilisés dans diverses applications, des chatbots aux assistants de codage. Cependant, l’exécution de ces modèles nécessite généralement un matériel puissant, comme des GPU haut de gamme ou des accélérateurs d’IA dédiés, qui peuvent être coûteux et consommer une puissance importante. Dans une vidéo récente, Binh Pham de la construction de la chaîne YouTube avec Binh montre comment rendre les LLM plus accessibles. Il a construit un bâton USB qui exécute un LLM local entièrement hors ligne, en utilisant rien de plus qu’un Raspberry Pi Zero W. Ce périphérique fonctionne comme un lecteur flash démarrable, permettant aux utilisateurs d’interagir avec un LLM en créant simplement un fichier avec un nom spécifique . Le modèle génère ensuite le contenu texte automatiquement et l’écrit dans le fichier. Au lieu d’utiliser des interfaces de chat traditionnelles ou des API, cette méthode d’interaction innovante exploite le stockage de masse USB et le mode Gadget Linux pour détecter et répondre aux changements de fichiers dynamiquement.

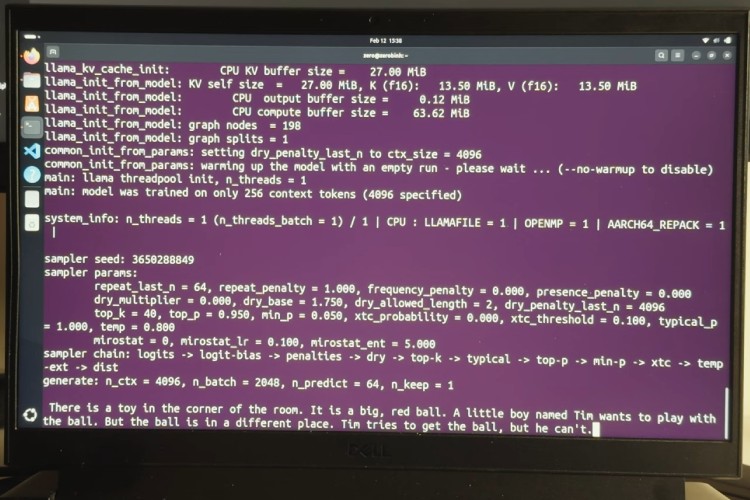

Pour y parvenir, BinH a modifié le framework llama.cpp pour compiler sur le processeur ARM1176JZF de Pi Zero, qui manque de support d’instructions néon d’ARM. Des versions standard de lama.cpp suppose de nouvelles architectures de bras, ce qui les rend incompatibles avec des appareils plus anciens. En ajustant les fichiers de construction CMake, il a réussi à compilé les modèles LLM sur le PI Zero, malgré son processeur de RAM de 512 Mo limité et monocœur. Les repères des modèles exécutés sur ce petit système révèlent les compromis de ce matériel à faible puissance: Tiny-15m génère des jetons à 223 ms par jeton, tandis que le plus grand lamini-T5-Flan-77m prend 2,5 secondes par jeton et SmollM2- 136m nécessite 2,2 secondes par jeton. Ces résultats mettent en évidence à la fois la faisabilité et les limites de l’exécution des LLM sur des appareils ultra-low-puissance. Bien que les performances actuelles soient lentes par rapport aux accélérateurs d’IA modernes, il ouvre des possibilités pour des solutions d’IA localisées et axées sur la confidentialité qui ne s’appuient pas sur la connectivité cloud.

Retrouvez l’histoire de Raspberry Pi dans cette vidéo :

-

Cas de bâtons USB - organisateur de lecteur flash, sac de carte | Étui USB cuir avec fermeture à glissière, école de bureau multi-skins, accessoire